"Meta-Physical Modeling" in der ästhetischen Forschung

Vortrag zur Eröffnung der Reihe "Ton und Prozeß" an der Technischen

Universität Berlin

, Dezember 2003

ausblenden

Inhaltsverzeichnis

1

Vorbemerkung

2

Ein möglicher Begriff von "Ästhetischer Forschung"

2.1

Ein möglicher Begriff von "Ästhetik"

2.2

Ästhetik der Analyse

2.3

Kompositorisches Tun als Forschungsprozeß

2.4

Die Sprache der Musik über Musik

3

Rechnerinterne Modelle Ästhetischer Produktion

3.1

Möglicher Nutzen des Digitalrechners im Bereich der Ästhetischen Forschung

3.1.1

Verfügbarkeit über Klangmaterial

3.1.2

Dokumentation und Nachvollziehbarkeit

3.1.3

Qualitativ Neues durch Quantitative Leistungsfähigkeit

3.2

Forderungen und Voraussetzungen

3.2.1

Definierbarkeit des Grundmaterials

3.2.2

Morphismen als First-Class Citizen

3.2.3

Punktuelle Morphismen und Kontextfreie Referenzierung

3.2.4

EXKURS: Grundlegendes Meta-Meta-Modell

3.2.5

Musikalische Anwendung

3.2.6

Lösungsansatz für eine mögliche Implementierung

4

Rückwirkungen

Liste der Notenbeispiele

Es ist mir eine besondere Freude und Ehre, im Rahmen der Kolloquiumsreihe

"Ton und Prozeß" in diesem Semester den Eröffnungsvortrag halten zu dürfen.

Dieses freundliche Angebot traf sich aufs Beste mit einem ohnehin geplanten Text,

--- allerdings war dieser für einen etwas späteren Zeitpunkt zu erstellen

vorgesehen, und ich bitte einige der Kürze der Vorbereitungszeit

zuzurechnende Mängel zu entschuldigen.

Weiterhin ist es mir Pflicht und Vergnügen, die "acknowledgements" ungewöhnlicherweise an den Beginn des Textes zu stellen: Der Titel dieses Vortrags ist nämlich mitnichten vom Vortragenden, sondern eine Ko-Produktion von Baltasar Trancón y Widemann und Thomas Noll:

Mit beiden Kollegen die Schwierigkeit besprechend, aus dem Stande heraus

eine zündende Überschrift zu finden, steuerten beide je ein Wortspiel bei.

Den so entstandenen Titel habe ich gerne als Strukturierungsgerüst

verwendet, und in diesem Sinne können die folgenden Darlegungen auch

als Invention über ein gestelltes Thema aufgefaßt werden.

Dieser Vortrag beschäftigt sich mit den grundsätzlichen Anforderungen an ein wünschenswertes zukünftiges Software-System, welches sowohl die Tätigkeit des Komponierens von Musik als auch deren ästhetische Analyse hilfreich unterstützt. Aus diesen Forderungen versuchen wir dann Grundsätze für eine mögliche Implementierung abzuleiten.

Die hier vorgetragenen grundsätzlichen Anforderungen ergeben sich aus

den Erfahrungen des Vortragenden als Komponist, Musiktheoretiker

und -pädagoge, und aus der Analyse der diesen Tätigkeiten

zugrunde liegenden Basisoperationen.

Der Vortrag gliedert sich entsprechend wie folgt:

Den Hörer mag es vorab beruhigen, daß die meisten der auftretenden Beispiele aus durchaus "klassisch bürgerlichen" Musikwerken stammen, und ihr Nachvollzug auch deren neuerliches Rezipieren evtl. bereichern kann. Der Vortragende ist nämlich der Auffassung, daß sowohl die analytische Aufarbeitung der Forschungsergebnisse der klassischen funktional-harmonischen Epoche noch längst nicht erschöpfend geleistet wurde, als auch, daß die weitere Erforschung und die (seit jeher in jedem Werk stes neu erforderliche!) Neu-Definition tonaler Wirkungsmuster lohnende Aufgaben für das eigene Komponieren bleiben.

Als letzte Vorbemerkung bitte ich noch um Verständnis, daß die Kürze der Zeit es noch nicht erlaubte, alle Belegstellen wiederaufzufinden.

Was wollen wir im Sinne der folgenden Darstellung sinnvollerweise unter dem Begriff "Ästhetische Forschung" verstehen?

In unserer Zeit hat die Entwicklung der Kommunikationstechnologien und die damit verbundene Vergrößerung der sozialen Kontexte auch Teile der sogenannten "Geisteswissenschaften" eine Haltung einnehmen lassen, in der die reine gedankliche Konsistenz ersetzt wird durch die "statistische Gesichertheit", --- eine Forschergruppe von Musik-Psychologen präsentierte auf der letzten ESCOM Tagung ein Projekt, in dem Hunderte von Studenten mit Hunderten von grob digital synthetisierten Fünf-Ton-Folgen malträtiert wurden und nach jeder einzelnen einen Maus-Klick abgeben mußten. Das unter Aufwendung erstaunlicher Fördermittel gewonnene Ergebnis bestand darin, nun endlich "gesichert zu wissen", daß moll traurig mache und staccato lustig.

So kontextfrei funktioniert Kunst --- wie jeder Künstler, jeder Kunstverständige und wohl auch jeder Kunstinteressierte weiß --- selbstverständlich nicht.

Dem gegenüber plädieren wir im Bereich der Ästhetik

für einen Begriff von Forschung, der

in Umfang und Methodologie eher "aufgeklärt-mittelalterlich" bis "hoch-barock"

zu nennen wäre, und in dem --- als seine wichtigste Besonderheit ---

a priori nicht zwischen dem Tun auf der Objekt- und auf der Meta-Ebene

unterschieden wird:

Forschung findet also nach dieser Auffassung

nicht nur in den heutzutage fraglos mit diesem Begriff verbundenen Arbeitsfeldern

der theoretischen Kunstreflexion und -analyse statt, also auf der Meta-Ebene,

sondern bereits schon im Tätigkeitsbereich des Kunstschaffens selbst,

im folgenden Objekt-Ebene genannt.

Der Sprachgebrauch, mit "ars" oder "Kunnst" (mit Doppel-Enn) die "Summe des Könnens" zu bezeichnen, gleich ob sich dies mit modernen wissenschaftlichen Methoden öffentlich oder im Meister/Schüler-Verhältnis quasi "zunftlich" und praktisch-fallweise tradiert, entspricht nicht nur dem Wissenschafts- und Kunstbegriff von Antike und Mittelalter, sondern hat sich --- dialektisch gespiegelt --- erstaunlicherweise gerade in den "harten" Ingenieursdisziplinen durchaus erhalten, wenn auch verschämt zur Metapher abgeschwächt: "Die Kunst der Stahlkonstruktion" oder "Die Kunst des Kanalbaues" oder "The Art of Computer Programming" sind tatsächliche Titel mehr oder weniger trockener ingenieurstechnischer Monographien.

Mit einem derartig zurück-geführten und somit scheinbar erweiterten Begriff von Forschung soll aber keinesfalls einer Aufweichung der harten Kritierien von Wissenschaftlichkeit das Wort geredet werden, --- selbst in einem so selbstbezüglichen Darstellungssystem wie der Musiktheorie, dazu später mehr, müssen die methodologischen Grundlagen spezifiziert werden, muß jede einzelne Erkenntnis nachvollziehbar und jede Aussage dem Diskurs unterwerfbar sein, müssen existierende Alternativmodelle und der Stand der Literatur zur Kenntnis genommen worden sein, etc.

Die Objekt- und die Meta-Ebene prinzipiell gleichberechtigt zu

behandeln und infolgedessen --- bezgl. des Einsatzes des Digitalrechners

--- auch mit nämlichen Mitteln zu unterstützen, ergibt sich auch

aus der historischen Tendenz ihrer zunehmenden Interaktivität:

Während vom reinen Wortsinne her die handwerklichen Techniken der Synthese

der Ebene des Kunstschaffens zuzuordnen sein könnten,

hingegen die Techniken der Analyse der Ebene der

Kunstreflexion, so ist in der Praxis eine solche Zuordnung seit Hunderten von

Jahren obsolet: Auch Autoren von Theoriebüchern komponieren Beispiele, und auch

Komponisten betreiben immer schon ständig (bewußt oder nicht) Analyse

eigener und fremder Werke im Zusammenhang mit dem Schaffensprozeß.

Spätestens mit den de-kompositorischen Satztechniken und reflektierenden

Themenstellungen der Klassischen Avantgarde

wurde diese Trennung vollends aufgehoben, da Analyse und Reflexion sich nun

auf der Ebene der Komposition, ja des kompositorischen Grundmaterials

finden lassen und in wichtigen Werken der Kreislauf zwischen

Objektschaffen und Theorie anschaulich thematisiert und nach-realisiert wurde.

Zunächst sei als Arbeitsbegriff für die folgenden Ausführungen definiert:

Ästhetik ist Erkenntnistheorie.

Genauer gesagt (aber immer noch grob genug):

Eine jede Ästhetische Theorie kann als Regelsystem betrachtet werden, welches

Klassen von Mustern (die sich vorfinden als

eingeprägt in das Material der sinnlichen Wahrnehmung)

in Verbindung bringt mit Mechanismen von psycho-interner Modellbildung.

Eine solche Ästhetik ist

eine durchaus praktische und konkrete Disziplin:

Viele Fragen im Felde der pädagogischen Methodik und Fachdidaktik

berühren eigentlich ästhetische Probleme, --- ganz zu schweigen von

den horrenden Summen, die jährlich in Werbung und Unterhaltung

umgesetzt werden.

Wenn z.B. bestimmte

Graphiken im Rechenbuch der ersten Schuljahre die Benutzer

(hier: Schulkinder) leiten sollen, ein psycho-internes Modell

der Grundrechenarten aufzubauen, dann hat die Art dieser

Abbildungen durchaus einen Einfluß auf den Vorgang dieser Modellbildung.

Dies kann äußerstenfalls gehen bis hin zu persönlichen Schwierigkeiten für ein bestimmtes

Kind, weil dessen persönliches Lernmuster zu stark inkompatibel ist

mit den angewandten visuellen Gestaltungsprinzipien.

Die eine Seite der Wirkungskette in diesen Beispiel wird gebildet durch

die psycho-interne Modellbildung selbst.

Diese ist in diesem Falle Forschungsgegenstand von Pädagogischer Methodik, Fachdidaktik,

psychologischer Grundlagenforschung, Meta-Mathematischer Forschung, etc.

Die andere Seite ist die konkrete graphische Gestaltung, und deren

Material besteht aus Dingen wie "geometrische Form", "Anordnungsmuster", "Farbwahl",

"Größenverhältnisse", etc.

Dessen Analyse gehört allemal in den Bereich der ästhetischen Forschung,

--- sie hat letztlich verwertbare Hinweise zu geben

an die Dispziplinen der Objekt-Ebene, welche

Mechanismen der psycho-internen Modellbildung unter welchen Bedingungen,

mit welcher Nachhaltigkeit, etc. angestoßen werden.

Die Meta-Ebene der Reflexion über ästhetische Phänomene wird im Falle der Musik einmal besetzt von den genuinen Disziplinen, also Musikwissenschaft und Musiktheorie, und daneben von anderen Wissenschaften wie Soziologie, Psychologie, Medizin, Physikalischer Akustik, welche sich die Musik mehr oder weniger berechtigt als Anwendungsfeld ihrer Methoden auswählen und sich dort mehr oder weniger erfolgreich betätigen.

Zusammenfassend läßt sich alle ästhetische Forschung auf dieser klassischen Meta-Ebene dahingehend, daß ihr Zweck darin besteht, die im Vorgang der Rezeption tatsächlich wirkmächtigen Mechanismen aus ihrer vor-bewußten Wirksamkeit in ein Format zu heben, welches dem betrachtenden menschlichen Geist deren bewußten Nachvollzug ermöglicht.

Komplexe Fragen wirft dabei auf die Musiktheorie als eine

ihrerseits "ästhetische Theorie", die eben nicht abgeleitete

Spezialisierung einer anderen Disziplin ist.

Betrachten wir deren Situation etwas genauer:

Zunächst einmal ist jedwede "Ästhetische Forschung"

i.A. stärker sensibilisiert als die meisten nicht-ästhetischen

Disziplinen für die Frage nach ihrer eigenen Meta-Theorie.

Die Mittel der Darstellung der möglichen Ergebnisse (Texte, Tabellen, Graphiken,

Notenbeispiele, Hörbeispiele) sind

nämlich natürlicherweise solche,

von denen jedes, sobald man es zu ergründen versucht, Gegenstand

einer Forschungsdisziplin ist, die ihrerseits zur ästhetischen Forschung

gehört.

Der Autor musikanalytischer, -theoretischer und -philosophischer

Texte ist sich häufig der Un-Begründbarkeit der anzuwendenden

Meta-Theorie und ihrer Sprachlichkeit bewußt.

Das unterscheidet ästhetische Forschung von der Tätigkeit des

Ingenieurs oder Naturwissenschaftlers, --- jedenfalls in der allgemeinen und

alltäglichen Arbeitsweise.

Jede Fixierung einer Erkenntnis ist formuliert als lokales System.

Dieses bedarf --- schon zur theoretischen Konstruktion einer Semantik ---

stets einer Ansammlung als funktionierend

vorausgesetzter, angeblich hinreichend spezifizierter und

als solcher importierter Nachbarsysteme.

In diesem Sinne ist eine explizite Problematisierung der Meta-Theorie

nur in wenigen Bereichen akzeptabel, oder gar üblich, und gesellschaftlich nützlich.

Ein Papier, das sich

z.B. mit der Stabilität von Stahlbrücken beschäftigt, kann es sich nicht

leisten, zunächst eine philosophisch konsistente Konstruktion der

Bedeutung von Aussagesätzen herzuleiten, damit diese im folgenden

auch verwendet werden dürfen.

Allerdings wird in den "höheren Regionen" dieser eher

handfest-praktischen Ingenieurs-Wissenschaften die Problematik

dann wieder durchaus vergleichbar:

In einem Radiogespräch [XXXXX] kritisierte unlängst

ein führender Vertreter der Mechanik die Bio-Technologie

und deren Machbarkeitsglauben auf das Schärfste, und zwar

aus der Position, daß die Biogenetik halt eine sehr junge

Wissenschaft sei, und die letztliche Un-Begründbarkeit ihrer Grundlagen,

den axiomatischen Charakter ihrer Handlungsbasis halt noch nicht in

all seiner Konsequenz erkannt habe.

Gerade in der Mechanik, so der Forscher weiter, sei, im Gegensatz zur

landläufigen Vorstellung von dieser als handfestester aller Disziplinen,

inzwischen Allgemeinwissen, daß alle Aussagen und Voraussagen nur innerhalb

bewußt gewählter Modellgrenzen gültig sind, und weiterhin

bereits durch die Wahl der Modell-Grundlagen schon entsprechend

prädisponiert werden.

Auf diesen selbst-reflektiven Stand müsse die Genetik erst noch kommen.

In der ästhetischen Forschung liegt dieser Schritt zur Meta-Theorie, z.B. zur Theorie der Sprache, schlichtweg näher : Wenn ich einen innermusikalischen Wirkungszusammenhang mit z.B. deutschsprachiger Prosa nachvollziehbar machen will, werde ich mir zumindest grundlegende Gedanken machen über deren immanente Wirkungsgesetze, da diese den Wirkungsgesetzen der Objekt-Ebene in vielen Punkten halt sehr nahe kommen.

Wenn es in einem Text z.B.

heißt "Großrhythmus, Harmonik, Instrumentation und Tonvorratsentwicklung

treffen sich alle in diesem einen Zeitpunkt !"

dann transportiert dieser Satz schon allein als

sprachlich-ryhthmisches Phänomen den gemeinten Eindruck und damit den Inhalt

von deutlich zusammenfallend sich schließenden Spannungsbögen.

Seine formale Gestaltung wird selbst zur Metapher, zum rhetorischen Bild

für den Begriff einer "überzeugenden Argumentation".

Lautete die Formulierung desselben Sachverhaltes

hingegen "Der Großrhythmus trifft sich hier mit

der Harmonik, die ja, wie schon oben erwähnt, hier auch mit den

mittlerweile gleichlaufenden Prozessen von Tonvorratsentwicklung und Instrumentation

zusammenfällt.", --- so wird der Leser diesem Rhythmus

wohl eine eher langweilige Verwickeltheit

verschiedener gegenseitiger Abhängigkeiten entnehmen.

Der Vortragende, aus seiner Erfahrung als Komponist, umgeht die

schwierige Frage nach einer Fundierung von Musiktheorie durch einen

(vom praktisch-inhaltlichen Standpunkt aus durchaus angemessenen) Trick:

Die klassische Musiktheorie darf sich zunächst (gleichsam völlig

unfundiert) in einem rein selbstbezüglichen

Modellrahmen bewegen, und innerhalb dessen analytische Aussagen treffen.

Die Nagelprobe aber müssen diese Aussagen bestehen, in dem sie

in einem zweiten Schritt vom Rezipienten in sein

persönliches Erleben integriert werden.

Damit hätte die Musiktheorie Ähnlichkeiten mit

bestimmten Techniken der Psycho-Therapie, z.B.

der NLP oder der Transaktions-Analyse.

Dies kann in der Sprache der momentan modischen Barbarei auch durchaus

eine "praktische Dienstleistung" genannt werden: Die konkrete

Erlebnisfähigkeit des Rezipienten, einem konkreten Werke gegenüber, und

infolge dessen auch im Allgemeinen, soll modifiziert und erweitert werden.

Ich behaupte: Jedem erfahrenen Musikliebhaber kann man am Klavier

die funktionale Definition des "fisis" im zweiten Kyrie der

h-moll-Messe demonstrieren, --- man kann diesen Ton nachvollziehbar

demonstrieren als zutiefst bezogen auf die den ersten Teiles der Matthäus-Passion

abschließende Choral-Phantasie,

und als im Widerspruch stehend zum abschließenden "Agnus Dei".

Die Kenntnis dieser Zusammenhänge

(oder besser: die Erinnerung an den einmal konkret gefühlten

Nachvollzug dieser Zusammenhänge) muß nun (allerdings nur unter günstigen Umständen)

konkrete Modifikationen ausüben

auf die Erlebnisvorgänge beim nachmaligen Hören, um als musiktheoretisch

korrekte Strukturaussage gültig zu sein.

"Wo Meta-Wissen ist, soll Erleben werden", ---

um ein Motto der klassischen Psychoanalyse

zu variieren, ja, zu invertieren.

Zusammenfassend: Erkannte Wirkungsmuster der Objekt-Ebene werden zum Gegenstand

der Meta-Ebene,

die so entstehenden Inhalte der Meta-Ebene aber wiederum rück-integriert

in die Objekt-Ebene als in eine kulturell-persönliche Ganzheitserfahrung.

Die Form und Fundierung der Meta-Ebene aber darf in diesem

Ansatz unbesorgt problematisch bleiben.

Warum aber kann hier das Kunstschaffen selbst, also die Arbeit auf der Objekt- und nicht der Meta-Ebene, als "Forschung" angesehen werden?

Der musikinteressierte Laie mag unter Umständen annehmen, Sinn und Zweck

des Komponierens sei es, ergreifende Melodien und interessante Klangereignisse

irgendwie aneinanderzureihen.

Th. Mann wies darauf hin, daß dieses Mißverständnis allein schon

durch die Wahl Ausdruckes "com-ponere" und seiner Konnotationen angeregt sein könnte.

Leider scheinen auch nicht wenige Komponisten-Kollegen dieser irrigen Auffassung

zu sein.

Was aber dem Laien verständnisvoll durchgehen zu lassen ist, kann bei diesen nur

als das bezeichnet werden, was es ist, und was auch auf die entsprechenden

kompositorischen Ergebnisse zutrifft: als grober Unfug.

Inhalt der kompositorischen Tätigkeit ist es nämlich nicht, entlang der Zeit

Ereignisse zu plazieren, sondern, ganz konträr,

genau spezifizierbare und (absehend davon, daß ihr Material halt zeitbehaftet ist)

durchaus außer-zeitlich, statisch definierbare ästhetische Probleme zu lösen .

So ist z.B: ein zentraler konstitutiver Aspekt der sechsten Sinfonie von

Gustav Mahler die Forschung zum Thema der "melodischen Verwendbarkeit

des Intervalles der Oktave."

Eigentlich nämlich (und in der klassischen Satzlehre auch explizit)

ist die Oktave zur Melodiebildung ungeeignet.

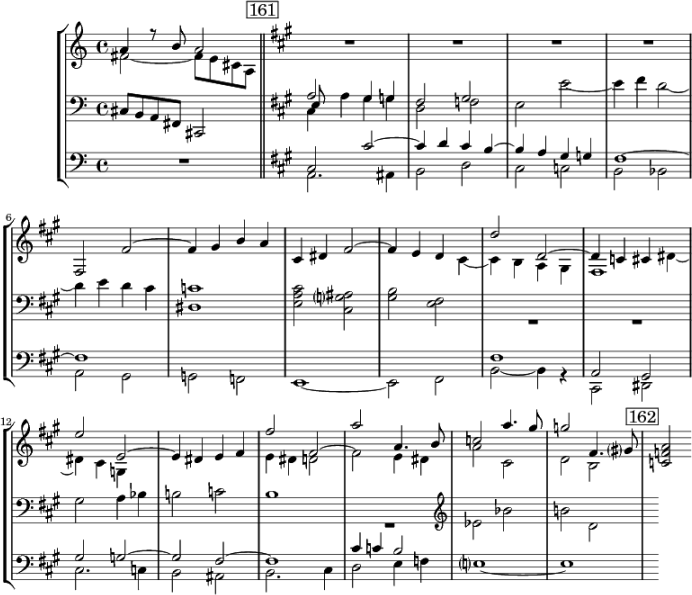

Mahler wendet nun die verschiedensten kompostorischen Maßnahmen an, um diese dennoch zu ermöglichen. Ihren Höhepunkt findet dies bei Ziffer 161 im Finalsatz (siehe Notenbeispiel 1 wo die beiden Anschläge der horizontalen (also "melodisch verwendeten") Oktave jeweils konsequent anders harmonisiert werden.

|

| Notenbeispiel 1: G. Mahler, Sinf. VI, 4. Satz |

Dieser Problemlösungsprozeß beinhaltet das In-Beziehung-Setzen von

Bestimmungsschichten unterschiedlich hohen Abstraktionsgrades, deren

jeweiligen unterschiedlichen Anforderungen an das zu erzeugende klangliche

Endresultat in materialgenerierende Konflikte treten.

Diesen Prozeß der "vertikalen" Kombinierung und Re-Kombinierung

von unterschiedlichen Aspekten der Struktur bedeutet das Wort "Kom-Ponieren".

Ein ganz typisches, ja triviales

Beispiel, das der klassisch-funktionalen Kompositionsweise entnommen ist:

Im Sinne einer beliebig wählbaren "harmonischen Logik"

soll über eine bestimmte Dauer ein "Modulationsprozeß" erfolgen, also eine

(irgendwie definierte) Vermittelung zwischen zwei unterschiedlichen

Zuständen eines Empfindungsraumes.

Materiell äußern sich derartige Zustände zumeist als Mengen von

vorausgewählten zugelassenen Tonklassen oder aber (am deutlichsten später bei

Webern) als nicht-oktav-abstrahierte "Felder" von ausgewählten Tonhöhen.

Nennen wir die zwischen diesen Endpunkten vermittelnde Sequenz von

Zwischenzuständen kurz "Modulationsplan".

Gleichzeitig soll ein bestimmtes motivisches Material in variierender Wiederholung

diesen Prozeß klanglich realisieren.

Sofort treten die Intervallverhältnisse dieses Motivmaterials und die

Intervallverhältnisse gegeben durch die Tonklassen-Auswahl des Modulationsplanes

in einen positiven, da materialgenerierenden Konflikt :

Manche konkreten Entscheidungen ergeben sich gleichsam "von selbst",

(auf welcher Stufe startet das Motiv ?),

die harmonische Disposition bewirkt Deformationen der motivischen Gestalt,

und umgekehrt kann die dem Motiv immanente Intervall-Logik es verlangen,

den ursprünglichen Modulationsplan noch durchaus weitgehend zu modifizieren.

All diese Konsquenzen sind aber selbst bei relativ simplen Prozess-Dispositionen nicht vollständig voherhersehbar. Die Durchführung dieses satztechnichen Vorhabens ist somit ein Forschungsprozeß !

Trotz aller grundsätzlicher Isomorphie und wünschenswerter Gleichbehandlung

von kompositorischem Tun und musiktheoretischer Analyse

darf das triviale Faktum nicht übersehen werden, daß das Einnehmen unterschiedlicher

Standpunkte auch unterschiedliche Wirk-lichkeiten schafft.

Ein klassisches und fundamentales Beispiel:

mit der Unterscheidung von "Satztechnik" als einer untersten Ebene

der Organisation eines Werkes und

"Harmonik" als einer darüberliegenden mittleren Ebene konstituiert die Musiktheorie

tatsächlich neue Gegenstände, die auf der

Objektebene in dieser Form gar nicht zu existieren brauchen.

Noch deutlicher ist das bei den großräumigeren Begriffen "tonale Disposition"

oder "Formproblem".

Dies sind verschiedenen Blickwinkel, also Abstraktionen,

die die theoretische Diskussion häufig einzunehmen gezwungen ist.

Die resultierenden Unterscheidungen sind keinesfalls scharf abgegrenzte

Bereiche auf der Ebene des Schaffensprozesses selbst.

Dem Komponierenden vielmehr kann das u.U. im besten Sinne "alles einerlei sein":

Wenn als Material eine diastematische Folge gegeben ist, also

eine Folge von Tonhöhen, so wird der Verfasser z.B.

zunächst dessen Selbstähnlichkeit

erforschen, also Symmetrie, Translation, seltener auch affine Ähnlichkeiten,

und all deren Kombinationen.

Ein derartiges analytisches Vorgehen findet sich als

natürliches Synthese-Verfahren in wohl allen

Kunstgattungen, -epochen und -stilen, und ergibt sich aus der grundlegenden

Prämisse ästhetischen Handelns, daß nämlich die Anzahl der initialen,

gleichsam willkürlichen Setzungen minimal sein sollte, und möglichst

alles weitere als nachvollziehbare Konsequenzen dieser initialen Setzungen ableitbar.

In der Musik ergibt sich diese Haltung spontan, sei es in der strengen

Satztechnik von Barock, Bach oder Beethoven, in der das betrachtete

Material aus diastematischen "Motiven" besteht, bis hin zur Klassischen

Avantgarde, wo Zahlenfolgen, Textausschnitte oder Generatorformeln auf diese

Weise auf ihre Produktivität hin ausgeforscht werden.

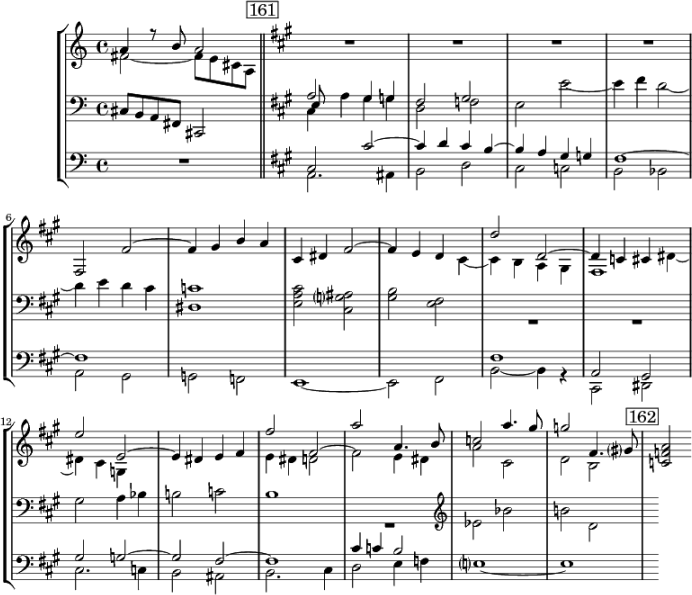

Weiterhin entspricht jeder Selbstähnlichkeit eine kanonische Abbildungsfunktion. Diese, rekursiv angewandt und transitiv abgeschlossen, bringt eine endliche oder unendliche Sequenz von (mehr oder weniger stark) transformierten Motiven hervor (Siehe Notenbeispiel 2)

|

| Notenbeispiel 2: Konsequente Fortsetzungen eines initial selbstähnlichen Motivs |

Eine geeignete derartige Sequenz zur Tonmengen-Sequenz vergröbert, nähert

sich bereits dem,

was in der Theorie-Sicht dem "Harmonik" genannten Bereiche zufiele.

Dem Komponierenden ist es lediglich Auffaltung (oder pathetischer gesagt: "Loslassen")

der Eigentendenzen des ursprünglich gegebenen einfachen Materials (z.B. "Fünftonfolge").

Besonders können in diesem Zusammenhang viele gegebene Folgen

von Tonhöhen (qua Abstraktion von der Oktavlage)

als Folgen von Tonklassen interpretiert werden,

was einen weiteren Schritt in Richtung "Harmonik" bedeutet,

und auf der Mikro-Ebene einer Oktavumfaltung im Motivablauf entspräche.

Derartige Ableitungsprozesse erstrecken sich zwanglos auf die Gestaltung anderer "Parameter": Falls z.B. die möglichen Rhythmisierungen dieses Motivs (und seiner Ableitungen) als sekundär behandelt werden, so ist eine mögliche Auffassung ihrer Wirkung die von wertenden Filtern auf der Intervallstruktur. Die Menge der überhaupt wirksamen Möglichkeiten zu solchen Filtrierungen kann ebenfalls a-priori bestimmt werden durch eine Analyse des intervallischen Materials.

Dieser Ableitungsprozeß erstreckt sich durchaus auch auf Fern-Beziehungen und großformale Disposition. Auch der Forschungsbereich namens "Formproblem", betreffend die "Makro-Gliederung", ist im schaffenden Denken nicht so stark vom Bereich "Material-Tendenz" der "Mikro-Ebene" abgesondert, wie oft in der abstrahierten Begrifflichkeit theoretischer Betrachtung. Zum Beispiel : Der Entschluß, eine Tonhöhenfolge in drei verschieden betonenden Ryhthmisierungen zu präsentieren (z.B. durch Phasenverschiebung zwischen talea und color), kann unmittelbar eine fünfteilige Großform induzieren (A -- Üb -- B -- Üb -- C ).

Konkreter: In allen klassischen SH-Sätzen sind die Schnittpunkte

der Großform die Anschlüsse zwischen den Formteilen der zweit- oder

drittobersten Ebene,

wie Exp-Schluß/Exp-Wdh-Anfang,

Exp-Schluß/Df-Anfang und am hochwertigsten Df-Schluß/Rp-Anfang

und (später dann) Rep.Schluß/Coda-Anfang.

In jedem Werk ist der Raum der Möglichkeiten für die Gestaltung dieser Schnittpunkte

deutlich determiniert durch das jeweilige thematische Material, genauer:

durch die konkrete Gestalt des Anfanges des Hauptthemas, durch die

im Hauptthemas enthaltenen Schlüsse,

durch das Anfangsmotiv des Seitensatzes,

die letzten Kadenz der Schlußgruppe, etc..

Nur diese Materialien stehen ja zur Verfügung

um die formalen Schnittpunkte letztlich klanglich zu realisieren.

In diesem Sinne sind die großformalen Architekturen von vielen der

wichtigen Werken in der

SHS-Form auch hörbar als Auffaltungen der Eigentendenzen des Materials

der Mikro-Ebene, und somit Ergebnisse ästhetischer Forschung.

So ist z.B. der Sextakkord, der den Repriseneinsatz im

ersten Satz der Neunten Sinfonie von Ludwig van Beethoven realisiert,

(erstens) zwar eine Negierung, gleichzeitig aber auch

(zweitens) eine Verdeutlichung

der Leerheit der leeren Quinte des allerersten Anfanges.

Der in ihm vollzogenen Dur-moll-Wechsel ist (drittens)

der Vertreter für den eigentlich

gemeinten Dominaten-Tonika-Wechsel (T-t statt D-t), --- jedweder Repriseneinsatz

kann ja gesehen werden als nichts anderes als dessen Auffaltung ins

"Formale", also ins Unermeßliche.

Die in der Musikgeschichte wohl einmalig darstehende Gewalt dieser Stelle ergibt sich also als Konsequenz von negierenden , dialektischen Mikro-Maßnahmen auf der Materialebene.

Derartige Auffaltungen der immanenten Tendenzen (von Material und Bezugssystemen)

sind zweifellos eine forschende Tätigkeit für das sie jeweils durchführende

und erlebende komponierende Subjekt selbst.

In vielen Fällen ist dies aber auch "Forschung" im engeren Sinne, dahingehend daß

die Resultate des

Erforschungsprozesses auch explizit mitgeteilt werden.

Zunächst einmal ist die schriftliche Fixierung des Ergebnisses der

kompositorischen Forschung bereits eine Mitteilung, wenn auch noch eine

implizit kodierte.

Im Gegensatz zur improvisierten Musik, bei welcher

im Verlaufe ihrer Entstehung und Aufführung der Forschungsprozeß an sich

zweifellos auch stattfindet, und von den Beteiligten vielleicht gar deutlicher

als solcher empfunden wird denn durch den Komponisten am Schreibtisch,

sind in notierter Musik die Ergebnisse in abstrahierter Form fixiert, und

diese Abstraktionen sind der Betrachtung, dem Vergleich, der Analyse etc.

zugänglich.

Diese allemal übliche Notierung ist aber noch keine explizite Mitteilung, wie oben gefordert.

Das Formulierungsmittel zu dieser Mitteilung ist in den seltensten Fällen das der reflektierenden sprachlichen Prosa. Die wenigen Exemplare derartiger Mitteilung, z.B. die Harmonielehren Schönbergs und Hindemiths, die Schriften Busonis etc., sind allesamt bedeutende Beiträge.

Ungleich öfter aber werden wiederum "ästhetische Mittel" eingesetzt,

um die dem Komponisten bewußt gewordenen Formzusammenhänge auch dem

Hörer mitzuteilen:

Um gleich das Paradigma schlechthin zu zitieren: In Bachs

Kunst der Fuge wird die Ebene der

graphischen Erscheinung des Notenbildes

für eine Vielzahl derartiger Mitteilungen genutzt:

Die Wahl der unterschiedlichen Schlüssel führt z.B. dazu, daß Transpositionen

von Motiven in verschiedenen Stimmen, und damit in verschiedenen

Systemen und damit in verschiedenen Schlüsseln

als graphisch identisch positioniert erscheinen.

Im selben Werk ist die Notwendigkeit von Hilfslinien häufig

auffällige Markierung eines formalen Schnittpunktes.

Aber auch in der Satzstruktur selbst gibt es bewußt gesetzte Maßnahmen.

Am konsequentesten ist auf der Großform-Ebene die Markierung des Goldenen

Schnittes durch einen iso-intervallischen Klang oder einen Terzknoten.

Die mit roher Gewalt eintretende dreifache leere Oktave zu Beginn des letzten

Abschnittes von Cp VIII scheint so dem Hörer aufs deutlichste einhämmern zu

wollen: Hört her, ich habe die Fuge und die SHS-Form zusammengeführt, und hier

beginnt der Beweis, nämlich die regelrechte Reprise.

Einen Höhepunkt hat diese Haltung im emanzipatorischen Pathos Beethovens : Ab der 8. Sinfonie werden die Gegenstände der Sätze zunehmend wie "Rätselaufgaben" exponiert, in Form eines zunächst unüberbrückbar scheinenden maximalen Kontrastes. Dieser wird dann a posteriori vom Komponisten als natürlicherweise möglich oder gar als notwendig bewiesen, --- und dies auf gewollt möglichst deutliche und einfach nachvollziehbare Weise

Prägnantes Beispiel ist die Exposition des Finalsatzes des

F-Dur-Streichquartettes op. 135 von L. v. Beethoven:

Innerhalb der Exposition erfolgt eine "Rückung" von F-Dur nach A-Dur.

Diese wird aber auf "geheimnsivolle Weise" "als natürlich verkauft",

und nicht als schwerwiegender Bruch wahrgenommen.

Bei der Wiederholung der Exposition aber geschieht dann logischerweise der

gegenteilige Bruch: das erreichte A-Dur stößt auf das eigentliche, initiale F-Dur.

Diese Stelle hingegen ist duichaus auf Konstrast gesetzt, wird als Widerspruch

empfunden.

Der Rest des Satzes ist danach dann damit beschäftlgit, diesen tonikalen

Widerspruch zu vermitteln, und über f-moll doch wieder zu F-Dur zu finden.

Ähnliches gilt für den Anfang der Einleitung der Klaviersonate op. 111:

Die ersten beiden Sonaten der Meta-Sonate op. 109 bis op. 111 standen in

E-Dur und As-Dur.

Der zeite Ton von op. 111, fis, wird in diesem größeren Zusammenhang

zunächst als ges gehört, also als Aufhebung der Tonikalität von As.

Dann aber umgedeutet zur (wie fast immer bei Beethoven hartverminderten)

Doppeldominante von c-moll.

Der Weg zum angestrebten erlösenden Mittelpunkt

von As und E, zum finalen C-Dur, geht

(jedenfalls in dieses Komponisten Weltsicht) nur über das c-moll.

Die duale harmonische Disposition findet sich in der Rückführung des ersten Satz des Streichquartettes B-Dur op. 130: Die Durchführung schreitet von D-Dur nach G-Dur nach c-moll, dies klingt sehr logisch. Dann aber wird eingeschoben ein C-Dur, eine Verdurung also, deren Härte ihresgleichen sucht, die auf den Verfasser aber durchaus den Eindruck einer schrecklich-falschen Schein-Reprise macht, so schneidend und falsch daß er sich ertappte dem Kollegen laut schreiend über die Jahrunderte hinweg zuzurofen; "Nein, nein, das ist doch das falsche Dur!".

Erst die Ver-mollung dieses falschen Durs eröffnet den Weg zur Erlösung, zur

Tonika B-Dur zurück.

Das vermittlende c-moll, das in op. 111 auf der großformalen Ebene als ein

ganzer, titanischen Fugen-Satz auskomponiert wurde, dauert hier gerade mal

drei Halbe Noten.

Der transmusikalische Gehalt aber (und der Name der Tonart!)

ist in beiden Fällen derselbe: Heimkehren in die Erlösung ist

allemal möglich, aber stets nur durch das Leiden hin-durch möglich.

Selbst Wagner, von dem Adorno sagte, (und das bezüglich

vieler Passagen seiner Werke durchaus mit Berechtigung!) sein Bildungsprinzip

sei die "Verschleierung der Produktionsweise durch das Produkt", ist in seinem

Spätwerk (ganz im Gegenteil!) bemüht, durch konsequente Benutzung von

Signal-Material (festgelegter Tonartgebrauch, wiederkehrende

Instrumentationsmuster, nicht-transponierende Leitmotive) das Grundgerüst

der formalen Architektur zu verdeutlichen.

Dies ist aber auch bitter notwendig, --- wäre die Bewußtmachung

formaler Zusammenhänge für den reflektierenden, vorbereiteten Hörer

nicht eine wichtige Schicht der

gestalterischen Intention, dann würden auch beim weniger reflektierten

Hören die großen Musikdramen ganz jämmerlich zerbröseln, --- ein zusammenhängender

fünfzehnstündiger Spannungsbogen gar wie im "Ring" wäre schlicht unkonstruierbar.

Fassen wir unseren Standpunkt zusammen:

Zumindest immer dann, wenn strukturelle Aussagen zwar im Material selber

formuliert werden, aber (neben ihrer sub-kutanen Wirkmächtigkeit,

für die Zeiten während der das bewußte Erleben

sich einmal auf anderen Ebenen beschäftigt)

durchaus als vom Hörer oder von der Leserin

bewußt nachvollziehbar intendiert sind, kann künstlerisches Schaffen

der Forschung zugerechnet werden.

Wie verhalten sich nun all diese Erfahrungen und Überlegungen, welche man in ihrer Grundhaltung durchaus im besten Sinne konservativ nennen könnte, zur Verwendung des Digitalrechners?

Inzwischen ist wohl allgemeine Überzeugung, daß die Einführung des

Digitalrechners in jeden bestehenden Arbeitsbereich diesen mittelfristig

umgestaltet, und das zumeist tiefgreifend.

Ein zu erstellendes Rechnersystem bildet unter gewissen Abstraktionen

zunächst zwar die vorgefundene Wirklichkeit (z.B. eines Frisiersalons) ab,

--- verändert

aber diese Wirklichkeit im Laufe seines Einsatzes durch seinen Einfluß

auf die Arbeitsrealität.

Zunächst beengt ein neu eingeführtes Datenverarbeitungssystem die

Entfaltungsmöglichkeiten des Arbeitenden, dann, nachdem es beherrscht scheint,

erweitert es diese ungemein, um sie, wegen der recht eng festgelegten

Bahnen seiner Operationalität, letztlich doch um so deutlicher einzuengen.

Dies mag im Falle des Frisiersalons unangenehm für Kunden und Angestellte sein. Im Falle der ästhetischen Produktion jedoch ist es insofern gefährlicher, als der Produktionsprozeß meist ein sehr persönlicher ist, --- nur der Meister, ein Bleistift und fünf Linien, --- und deshalb unbewußte Beeinflussungen von Satztechnik und Stil weniger stark einer gesellschaftlichen Korrektur unterworfen sind als ein zu starres Abrechnungssystem, über das sich eine Mehrzahl von Betroffenen gemeinschaftlich ärgern kann.

Betrachten wir also zunächst den erwarteten, teilweise ja schon realisierten und die Einführung des Digitalrechners in die ästhetischen Forschung motivierenden Nutzen, und dann die sich aus obiger Analyse ergebenden Grund-Forderungen, die bewirken sollen, daß der den Nutzen aufwiegende Ärger sich in Grenzen hält.

Lassen wir uns beispielhaft aus den vielen Anwendungs-Szenarien des Digitalrechners in der Ästhetischen Forschung wenige herausgreifen, --- zum einen das quantitativ dominierende, da wirtschaftlich durchaus bedeutende, der unmittelbaren Produktion von Klang durch den Rechner, andererseis einige der mehr esoterischen und im Sinne unseres Themas deutlich interessanteren.

Die Hauptmotivation zur Hervorbringung der mittlerweile verfügbaren

kommerziellen Anwendungen des Digitalrechners im Bereich der Musik

sind allemal kommerzielle:

Die Löhne von Hunderten von (normalerweise eh' schon

nicht gerade üppig bezahlten) Studiomusikern sollen eingespart werden,

in dem Sequenzer und Signalverarbeitungsalgorithmen die Aufgabe von

Interpret und Instrument übernehmen.

Der gesamtgesellschaftliche kulturelle Schaden, sollte sich dieser Prozeß ungehemmt

durchführen lassen,

kann nicht hoch genug eingeschätzt werden, --- spät genug fanden diesen

Jahres Streiks im New Yorker Boulevard-Theater-Viertel statt, aber auch

danach wird das Problem wohl immer noch als ein persönliches von ein

paar wenigen Leuten mit einem halt aussterbenden Beruf eingeschätzt.

Es kann sich mittelfristig durchaus zur kulturellen Katastrophe entwickeln.

Der ernsthafte Einsatz des Rechners in Komposition, musikalischer Analyse, Pädagogik etc. profitiert allerdings von dieser Entwicklung, da die Schnittstellen zu diesen kommerziellen (aber auch durchaus barbarischen) Systemen es ermöglichen, Notentexte zu edieren, Melodien direkt vorzuspielen, Schallaufzeichnungen zu archivieren und genau zu indizieren und so mit anderen Materialien (wie analytischen Kommentaren) zu attributieren, etc.

Was in den Sechziger-, Siebziger und frühen Achtziger-Jahren mit

selbstgelöteten Schaltkreisen, eigenen SIO-Treibern und Batterien von

Z80-Prozessoren

komponiert und musiziert worden ist, ist der Analyse und Rekonstruktion

größtenteils endgültig verloren.

Wer damals idealistisch (oder Student/Studentin kurz vor dem Examen) war,

malte publikationsreife Partituren, mit genauen Schaltplänen

und den Quelltexten der beteiligten Computerprogramme im Anhang.

Diese Dokumente ermöglichen aber zumeist lediglich einen "idealisierten" Nachvollzug,

oder versperren gar eher --- wegen ihres zu niedrigen Abstraktionsgrades

--- den Zugang zum gemeinten Werk.

Mit einer MAX oder PD Schaltung ist das schon anders, --- die durch diese

Produkte erzielte Normierung erlaubt nicht nur eine gewisse technische Portabilität,

sondern auch --- viel wichtiger noch --- inter-humane

und zeitüberdauernde analytische Kommunikation.

Für die Aufgaben von Klangproduktion und -verarbeitung sind

die quantitativen Leistungsmerkmale heutiger Rechner direkte Voraussetzung,

und stehen in linearer Abhängigkeit zum Umfang der zu bewältigenden Aufgabe.

Anders im Bereich der ästhetischen Forschung: Hier sind diejenigen

Aufgaben interessant, welche erst mit der Quantität der Verarbeitung überhaupt

möglich wurden, --- mit deren Erfüllung also Quantität in

neue Qualität umschlägt.

Die Vergleiche von Tausenden von melodischen Gestalten, das Ausrechnen komplex definierter Symmetrieverhältnisse schon für einfache Klänge, die Bestimmung aller Selbstähnlichkeiten in Zwölftonreihen, --- all dies sind Beispiele für analytische Ansätze, die in impliziter Gestalt zwar schon lange denkbar sind, deren Explizit-Machen allerdings, aus rein quantitativen Gründen, erst durch den Digitalrechner sinnvoll möglich wird.

Dies sind u.E. die wirklich spannenden Bereiche, in denen ästhetische Forschung und Digitalrechner, also Informatik, sich auf gleicher Augenhöhe begegnen und gegenseitig anregen und weiterbringen können.

Eine erste, aller-allgemeinste Forderung als Konsequenz aus vorstehenden

grundsätzlichen Überlegungen ergibt sich dahingehend, daß keine

scharfe Trennung gezogen werden kann und soll

zwischen dem Rechner-Einsatz beim eigentlichen Kunstschaffen und

dem für die Aufgaben der kunsttheoretischen Reflexion:

Auch wer eine theoretische musikanalytische Arbeit schreibt, hat mit

Klang- und Notenbeispielen zu tun, --- mit unterschiedlichen Textdrucktypen, mit

Graphiken und ihrer Farbgestaltung, etc. Hingegen, wer z.B.

im Stil der Klassischen Avantgarde komponiert,

kann dabei durchaus längere Texte, Videos

oder Datenlisten in ihre/seine Partitur integrieren wollen.

Die wichtigste inhaltliche Forderung, auch schon in unserem

ersten großen Softwareprojekt in diesem Bereich, dem AUDIAC Projekt,

in den Mittelpunkt gestellt, ist die nach

Ideologieneutralität .

Dieses Schlagwort soll ein Prinzip bezeichnen, demzufolge

keine Ansichten, Herangehensweisen,

Meta-Modelle etc. prinzipiell bevorzugt oder benachteiligt werden.

Die konkreten technischen Mittel zur Realisierung dieser Forderung

bestehen in z.B. offener Architektur, generischer Definition von Diensten,

sauberer Modularisierung mit hinreichend präziser Schnittstellenspezifikation, etc.

Diese abstrakte Forderung hat als erste, aber wohl weitreichendste Konsequenz die konkrete Maßgabe, daß bereits die primitiven, also bereits die allen komplexeren Datenstrukturen zu Grunde liegenden Datentypen benutzerdefinierbar sein müssen.

BEISPIEL

ST = { c, d, e, f, g, a, h }

TH1 = ST * Int

TH2 = ST * { bb, b, -, #, ## }

TH3 = ST * { -, # }

TH4 = { c, cis, d, dis, e, f, fis, g, gis, a, ais, h }

|

Daraus wiederum folgt umittelbar, daß alle Bibliotheksfunktionen und vom

Rahmenwerk angebotenen Dienste generisch formuliert sein müssen,

da sie ja in unvorhersehbaren Kontexten nützlich sein wollen.

Wenn eine Bibliotheksfunktion zur Organisation rhythmischer Prozesse zur

Verfügung steht, will der Nutzer sich dieser frei bedienen können, völlig unabhängig

ob sein Tonhöhenmaterial, --- was ja mit der Rhythmuskonstruktion u.U. gar nichts

zu tun haben muß, --- klassisch-temperiert, ekmelisch, klassisch-avantgardistisch

oder wie auch immer definiert ist.

Die Abbildung kompositorischer Maßnahmen in die Vordergrundgestalt ist

nicht-injektiv.

Ersetzt der Komponist an einer bestimmten Stelle der entstehenden Partitur

in einer Ereignisfolge, in der

nur einmal die Tonhöhe "f" auftritt, diese durch ein "fis",

so können dieser selben Vordergrund-("VG-")Transformation

die verschiedensten Mittelgrunds-Maßnahmen

entsprechen. Hier einige der unendlich vielen Möglichkeiten:

Es ist klar, daß alle diese Transformationen auf das Beispielmaterial angewandt "zufällig" dasselbe VG-Ergebnis liefern, --- auf andere Materialien angewandt sich in ihrer VG-Konsequenz aber u.U. gravierend unterscheiden.

Benutzt man ein kommerzielles Notensatzprogramm zum Komponieren, dann kann man auch zwar auf die Notengraphiken "klicken" und komfortabel ihre Tonhöhe mit dem Mausrad verschrauben, --- welche der verschiedenen Mittelgrund-Maßnahmen der Benutzer aber meint damit auszuführen, bleibt dem Rechner natürlich unbekannt.

Soll aber ein Rechnersystem den tatsächlichen Kompositionvorgang unterstützen,

so muß das Datenmodell nicht die linearisierte Vordergrundgestalt

abbilden, sondern vielmehr den Mittelgrund der kompositorischen

Entscheidungen.

Diese sind grundsätzlich zu modellieren als Morphismen, also als

modifizierende Operationen über Daten, die ihrerseits

Morphismen sein könnten.

Glücklicherweise bereitet eine derartige Modellierung heute,

ansgesichts der erreichten

Rechengeschwindigkeiten und beim Stand des Wissens über Programmiersprachen

und Semantiken im Allgemeinen, keinerlei grundsätzliche Probleme mehr.

Auch im Bereich der Analyse sollte eigentlich diese Mittelgrund-Struktur das Datenmodell ausmachen. Ein Rechnersystem sollte darstellen und bearbeiten können so un-fertige Dinge wie ...

Hier wird endgültig deutlich, daß die derartigen Daten zugrundeliegenden Deklarationen nur benutzerdefiniert und fall-spezifisch in das System eingebracht werden können.

Zwei weitere, eng zusammenhängende, Anwendungsfälle jedoch machen durchaus Probleme unter konventionellen Codierungsverfahren:

In allen Gattungen, Epochen und Stilen werden in der ästhetischen Produktion Algorithmen eingesetzt, welche großflächige Strukturen generieren, die durch die Setzung weniger Parameter eindeutig festgelegt werden können.

Auf dieses Handwerkszeug scheint niemals vollständig verzichtet worden zu sein.

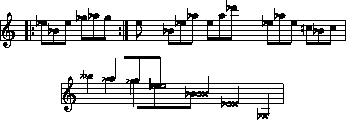

Aber ebenso unverzichtbar scheint es, daß in einer zweiten Phase von Bestimmungssetzung das schaffende Subjekt das Ergebnis dieses Algorithmus (wegen vom Verwendungskontext bestimmten ästhetischen Notwendigkeiten) im Nachhinein punktuell modifiziert.

Diese Möglichkeit wird in der klassischen Satztechnik als licenca bezeichnet. Ihre rechner-interne Realisierung wird dadurch noch erschwert, daß ein derartig punktuell modifiziertes Material wiederum zum Gegenstand automatisierter und global definierter Transformationen werden können soll.

|

| Notenbeispiel 3: C-Dur Arpeggien ohne und mit punktuellen "Lizenzen" |

Eng verwandt ist das Problem, welches wir mit "kontextfreier 0Referenz" bezeichnen wollen. In allen herkömmlichen Systemen ist es nur möglich auf ein individuelles Element eines größeren corpus zuzugreifen, in dem dieses ausgehend vom und relativ zum Gesamtkontext gleichsam funktional adressiert wird: Man kann i.A. durchaus auf Objekte zugreifen wie "die dritte Note im zweiten Takt der vierten Stimme des momentan bearbeiteten Dokumentes".

Die rechner-interne Modellierung von Kompositions und Analysevorgängen

erfordert jedoch eine direkte Referenzierbarkeit von Unter-Objekten, die

durchaus in verschiedene Kontexte gesetzt werden müssen, ohne ihre

Identität zu verlieren:

Will man z.B. aus einer Folge von ausnotierten Violin-arpeggien, wie sie

in einer Partita auftreten, den dargestellten

vierstimmigen Satz in "Grundform" extrahieren, so

muß man in existierenden Notensatz-Systemen ein neues Textobjekt anlegen

und entsprechend füllen. Gleich ob das händisch oder automatisiert geschieht,

die Tatsache, daß jenes "fis" im Original "dasselbe" fis ist wie in der

lediglich vereinfachten vierstimmigen Schreibweise läßt sich mit

genuinen Mitteln der Datenstrukturen nicht ausdrücken.

Wie kann nun eine Implementierungsstrategie aussehen, welche all diese Wünsche und Forderungen erfüllt?

Als unterste Grundlage diene im folgenden ein weitestgehend vereinfachter Auszug

aus der Erkenntnistheorie Immanuel Kants .

Man könnte ein gleichartiges und gleichermaßen geeignetes Meta-Modell

sicherlich auch

auf der Grundlage und mit den Begriffen von Zeichentheorie, Systemtheorie,

platonischem Idealismus o.ä. definieren.

Ich persönlich bevorzuge dieses, das sog. "transzendental-analytische",

weil es eines der ältesten und ein so schön einfaches ist.

Es "geht", weitest möglich vereinfacht, so:

Nach dem Prinzip des "Transzendentalen Idealismus und Empirischen Realismus"

definiert sich Erkenntnismöglichkeit im Spannungsfeld zwischen der

"wahrnehmbaren Wirklichkeit" und der "transzendenten Dinglichkeit":

Eine (im naiven Vorverständnis:) "objektiv vorhandene", oder

"unabhängig vom Dasein des Menschen definierte und für alle Menschen dieselbe seiende"

oder eine "an sich seiende" Dinglichkeit,

also eine (im naiven Vorverständnis:) "objektive Realität"

wird einerseits vorausgesetzt.

Andererseits wird diese als uns Menschen völlig unerfahrbar deklariert:

Jede Erfahrung ist vielmehr ein Drittes, nämlich

unauflösliches Produkt dieses "Dinges an sich" und

unseres eigenen, je persönlichen Erkenntnisvermögens.

Aus den so gewonnenen Empfindungen konstruieren wir dann

in Nachhinein eine sogenannte Wirk-lichkeit als psycho-internes Modell.

Diese Wirklichkeit wiederum ist jedem Menschen eigen, und als solche nicht

kommunikabel.

Kommunikabel sind lediglich neue, weiter abgeleitete Modelle, genannt

physisch übersetzbare Modelle, welche wir mit unserer Hände Arbeit

in die Physis des

Dinges-an-sich durch rohe Gewalt einprägen: Kleckse und Hälse auf fünf Linien,

Schallschwingungen im Luftraum, oder Körper aus Marmor.

Jene o.e. Vermischtheit von Wahrnehmungsvermögen und Ding an sich ist eine qualitative. Realität und Wirklichkeit sind zwei völlig inkomensurable und auf ewig geschiedene Welten, --- es gibt kein gemeinsam enthaltendes System, welches ein Auseinanderrechnen dieser Größen, also ein Extrapolation auf das Ding an sich, erlaubte. ...

In diesem meta-meta-modell würde man einen Gegenstand wie "Beethovens Fünfte Symphonie" als Teiles des Dinges an sich ansehen, über welches also --- qua Konvention --- durchaus miteinander geredet werden kann, welches aber erlebbar und wirkmächtig ist immer nur als psycho-internes Modell, und damit für jeden Menschen als ein anderes.

Scheint zunächst dieser Ansatz den Bereich möglicher Aussagen ästhetischer Forschung endgültig ins Nebulöse zu verlegen, so ist doch das Gegenteil zutreffend: In diesem Modell ist ein Ding wie "Beethovens Fünfte Symphonie" genau so ding-lich und wirk-lich wie ein Stück Kreide oder eine Stahlbrücke, welche ja auch, je nachdem ob ich gezwungen werde, sie zu berühren, oder ob sie mir gegen den Schädel prallen, je andere psycho-interne Modelle induzieren.

In dieser allervereinfachtesten Form scheint dieses gewählte Meta-Meta-Model schon fast selbstverständlich, ja trivial, und scheint zu unseren praktischen Problemen nichts beizutragen.

Im Gegensatz zu allen anderen Bereichen ästhetischer Produktion zeigt sich

aber im Bereich der Musik eine überraschend konkrete Konsequenz:

Hier ergibt sich einzigartigerweise, daß

dieses grundlegende Modell in die Struktur des Objektes hinein

übertragen werden kann, --- es beschreibt, angewandt mit

entsprechend viel feinerer Granularität, das Zusammenspiel der

(gleichsam materiellen) Einzelelemente der physischen und intra-psychischen Modelle.

Dies ist so nicht gegeben in anderen ästhetischen Wissenschaften:

Zwar forscht u.U. auch die philologische Edierungstechnik um die Schreibweise

eines einzelnen Wortes in einem gegebenen Manuskript, oder um die Setzung eines

einzelnen Kommas in verschiedenen Ausgaben.

Der Gegenstand ihrer ästhetischen Forschung jedoch ist der (wiederholte)

Wortgebrauch oder die Zeichensetzung in einem größeren Kontext und

einer Mehrzahl von Fällen.

Ebensowenig wird die Theorie der Malerei, selbst bezogen auf ein Ölgemälde des Pointillismus, sich normalerweise mit einem einzelnen Pinselstrich oder "Pixel" beschäftigen.

Seltene Ausnahmen sind allerdings z.B. die singularistische Wirkung des Ausrufes "Klopstock" im "Werther", oder die Semikolon-Funktion des gedruckten Doppelpunktes nach dem "Zufrieden jauchzet Groß und Klein", oder der eine, einzige rote Pinseltupfer, der im Auge eines Selbstproträts van Goghs den Lebensfunken nicht nur ab-bildet, sondern ihn gar selbst bildet (welches Bild in der Pariser Orangerie dankenswerterweise so gehängt war, daß der die Treppe hinansteigende und auf dem Absatz umbiegende Besucher von diesem einen einzigen roten Punkt getroffen wurde wie von einem Augenblitz).

Anders in der Musik: Hier sind die Einzel-Elemente der Struktur regelmäßig auch als Einzelne Gegenstand des Diskurses: Dies bezieht sich sowohl auf Atome eines speziellen physisch dargestellten Modelles (von dem natürlich wieder zunächst ein intra-psychisches gebaut werden muß), also einer geschriebenen Partitur, als auch auf diejenigen Bestandteile des Dinges-an-sich, welche gemeinhin als "Einzel-Ereignisse" bezeichnet werden.

Zunächst einmal unterscheiden sich die rein editionskritischen Bemühungen

mitnichten von denen in der Literaturwissenschaft.

Darüber hinaus aber ist es durchaus üblich, daß über einzelne Töne,

Staccato-Punkte oder Klavier-Anschläge lange und erbitterte Dispute

geführt werden, die tatsächlich weitreichende ästhetische Inhalte

zum Gegenstand haben, wenn nicht philosophische oder gar politische!

Trefflich gestritten wurde z.B.

Besonders einige Werke Heinrich Schenkers, z.B. seine Monographie zur Neunten Sinfonie, sind paradigmatisch dafür, wie viel Philosophie in einem einzigen staccato-Punkt stecken kann.

Daß diese "punkt-weisen" Betrachtungen durchaus zentrale ästhetische Fragen des Kontextes einschließen ist zumindest jedem leidvoll klar, der einen entsprechend anspruchsvollen oder erbarmungslosen Instrumentalunterricht mitmachen durfte, und der Wochen brauchte, bis das "ges" in Takt 17 so klang, wie es der Kontext --- jedenfalls in der Interpretation des Unterrichtenden --- verlange.

Dieses zunächst rein philosophische Phänomen legt unmittelbar eine digitaltechnische Implementierungsstrategie nahe, nämlich durch "konsequente Objektorientierung", also ko-algebraisch fundiert.

Fast alle "objektorientiert" genannten Programmiersysteme

(Ausnahme: Tupel-Typen in Eiffel)

vermischen Algebraische Spezifikation der Typen mit zustandsbehafteter

Generierung der Instanzen.

Objektklassen werden als Produkte definiert, d.h. ihre Attribute

müssen im Vorhinein vollständig festgelegt werden, --- aber ihre Instanzen

werden dann durch einen imperativen Akt ("new()") erzeut,

als eine Identität unabhängig

von ihrem (gleichsam "algebraisch gemeinten") Datenzustand.

Demgegenüber steht die Architektur, die wir, also der Verfasser und sein

Kollege Baltasar Trancon y Widemann, vorschlagen:

Mit einer in den entsprechenden Systemteilen konsequent

"ko-algebraischen" Fundierung und Implementierung können sowohl oben

aufgezählten Generizitätsforderungen, als auch die kontextfreie Referenzierung

auf natürliche Weise realisiert werden.

Die Tatsache, daß tatsächlich jedes fein-granulare materielle Bestandteil

Objekt einer Aussage (oder eine Relation) sein kann und sein können muß, ermöglicht

und erfordert den

umgekehrten Implementierungsansatz:

Jede rechner-interne Repräsentation eines solchen Modell-Atoms erhält zuförderst eine

Identität.

Beim ersten Erstellen oder beim späteren Erweitern des Modelles

wird jedem einzelnen Bindebogen, jeder Note und jedem Taktstrich

als erstes mit seiner Erzeugung gesagt: "Du Freitag", --- und von diesem

Namen muß dieses eine Ding sich von nun an angesprochen fühlen.

Alle zukünftig stattfindenden Attributierungen sind sekundär,

einschließlich der in das Modell einzutragenden Relationen zwischen

den Elementen des corpus.

Es mag eine intiale Attributierung stattfinden, die auch die "algebraische

Unterscheidbarkeit" garantiert, z.B. eine automatische Vergabe eines Identifikators

oder einer Zeitmarke.

Entscheidend aber ist, daß alle im

Laufe eines Forschungsprozesses erst später als notwendig erkannten

Attributierungen, --- ja, alle denkbaren Attributierungen überhaupt,

im Nachhinein an ein bereits konstruiertes Modell angeklebt werden

können.

Diese Attribute bleiben, wenn gewollt, erhalten, und das Datenobjekt

ist immer eindeutig über seine Identität wieder erreichbar,

unabhängig von den allerverschiedensten Kontexten, in die es

im Verlauf von Synthese und Analyse zwangsläufig gestellt werden muß.

Wir sind überzeugt, daß ein derartiger, co-algebraisch fundierter

Ansatz grundsätzlich dem Problem des komplex vernetzten und dynamischen

Modelles, wie es eine Komposition in ihrem Enstehen oder ihrer analytischen

Zerlegung darstellt, adäquat ist und, wenn einmal implementiert,

eine bequeme Definition von Editoren, Analysewerkzeugen, Renderern usw. erlaubt.

Nicht bequem jedoch, vielmehr noch eine ganze Menge an angewandter

Grundlagenforschung wird es sein, ein funktionsfähiges Meta-Modell

erst einmal "an's Laufen zu bekommen".

Letztlich stellt sich heraus, daß das Wortspiel vom

"meta-physical modeling" noch nicht einmal Metapher, sondern vielmehr

zutreffende Beschreibung einer weitergehenden meta-theoretischen Rückwirkung ist.

Wenn nämlich beim "physical modeling" z.B. eine Flöte oder Violine

als physikalisch-mathematische Simulation konstruiert wird, dann

kann auf allereffektivste Weise, gleichsam in Echtzeit,

eine unmittelbare Aussage über die Güte der Modellierung

getroffen werden, nämlich durch einfachen Hörvergleich des Originales mit der

Rechner-Nachbildung.

Diese Aussage über die Adäquatheit des Modelles, abgeleitet von seiner

Unterscheidbarkeit vom Original, macht aber in einem zweiten Schritt

Aussagen über die Güte der hinter der Modellierung stehenden Theorie

des konkreten Instrumentes, --- wenn das Modell halt noch nicht ganz so klingt

wie eine Oboe, dann ist die zugrundeliegende Theorie der Oboe halt noch

nicht hinreichend fein.

Nämliches gilt nun auch für die Modellierung der ästhetischen Entscheidungssysteme:

Kein Algorithmisches System wird die Spontaneität ästhetischer

Entscheidungen jemals totaliter modellieren können. Dies ist

weder möglich noch gar wünschenswert.

Im Gegenteil, --- gerade die Lücken der Modellierung, die Stellen, an denen das Gewünschte und das Erzeugte nicht vollkommen kongruent sind, die rough-edges, welche jener punktueller Morphismen zu ihrer Korrektur bedürfen, --- gerade diese Unvollkommenheiten sind es, welche Aufschluß gegen können über die Wirkungsweise der gestalterischen Maßnahmen im menschlichen Denken. Gerade diese Stellen, an denen der menschliche Geist den maschinellen über-steigt können beitragen zu einer genaueren Vorstellung vom Funktionieren unserer Vorstellung.

made

2014-01-10_16h53

by

lepper

on

heine

produced with

eu.bandm.metatools.d2d

and

XSLT